作者 | 張祥威

編輯 | 德新

智駕方案的降本行動仍在推進。

早年,單視覺L2市場的玩家以Mobileye、博世為主,后來國內智駕公司加入,共同推動 1V、1R1V、nR1V等不同的方案興起,L2近乎成為車輛的必備功能。

當下,在行業降低智駕成本的大背景下,有行業公司提出,可以推出成本極致下探的單視覺L2方案,并能解決行業的兩大痛點:

降低AEB誤報率,幫助車企拿到CNCAP五星成績;

支持數據回傳,為高階智駕迭代打下基礎。

與以往的L2方案相比,今天的單視覺L2正在變強,且有了更高的可靠性,成為主機廠向高階輔助駕駛進軍的入場券。

2017年,隨著特斯拉Model 3開啟規模交付,L2逐漸進入公眾視野。

國 內市場中,先后出現1R1V、3R1V、5R1V的L2方案,后來還出現了加入激光雷達的L2+方案。再后來,隨著主機廠降本、便于管理的需求,又出現了行泊一體等。

對性能的極致壓榨,其中一個代表是特斯拉。其采用144TOPS的算力堅持使用120萬像素的攝像頭,來實現L2、L2+的功能更新,并且一直在做傳感器的減法,比如去掉毫米波雷達等。

國內主機廠在極致成本競爭下,也已經開始做減法,行業開始出現去高精地圖、去雷達等聲音。

回到L2方案上,過去行業的主流做法是通過1R1V方案來實現L2功能,比如AEB等。

為了降 低成本,行業后來又開始去掉毫米波雷達,出現1V方案。不過,去掉毫米波雷達后,僅依靠單個攝像頭容易發生“幽靈剎車”,就是AEB誤觸發率高的問題。

要解決傳統的1V方案幽靈剎車的問題,需要大量的數據,但是又不能拿量產車主機廠當小白鼠。主機廠希望降低成本,又擔心去掉毫米波雷達產生的幽靈剎車。這是過去行業推進「1V」這種極簡L2方案時遇到的問題。

為解決AEB的誤觸發,MAXIEYE做了多種算法冗余,通過兩套甚至更多套不同的算法來進行目標物的檢測,不同算法的檢測特征、原理是完全不同的,并可以相互校驗。

比如,對行人的檢測,一套算法會檢測行人的整體輪廓,另一套算法會檢測行人的關節、頭等局部特征。

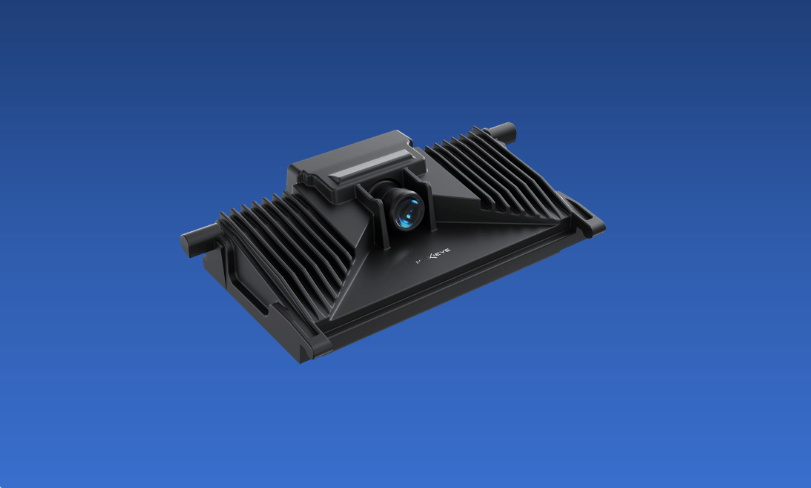

5月24日,智駕科技MAXIEYE發布了 牧童MonoToGo 單視覺L2解決方案,水平視角 100°,探測距離 200m,面向5-15萬主流車型,一站式實現L2全功能集成,具備數據閉環全場景復現、事件觸發數據回傳等功能。

面向當下單V行業痛點,該方案針對性解決了AEB誤觸發等問題,滿足 CNCAP五星+主動安全評分。

極簡的L2方案再次被刷新。

據悉,這款單視覺L2方案的Vision Only產品在CNCAP標準測試中,主動安全ADAS部分更是得到了 88.56%的分數。

要獲得CNCAP主動安全五星,需要系統具備很高的敏感性,同時保證量產時AEB不會出現誤觸發,考驗方案的平衡能力。許多主機廠為了讓量產的車減少誤觸,會把系統調整得很保守,從而無法獲得CN CAP的五星高分。

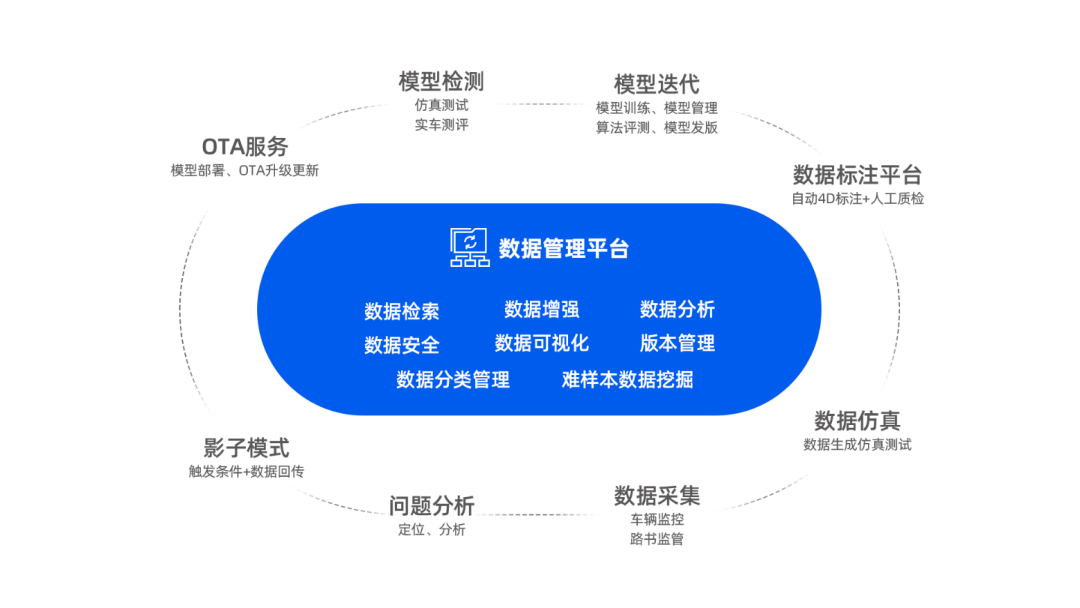

值得一提的是,MAXIEYE單V產品刷新系統安全指標,這背后有一套數據迭代的邏輯。

隨著量產上車的方案不斷積累更多數據,MAXIEYE會不斷地訓練這套視覺方案,精度、性能、場景隨之提升,從而在主動安全上獲得更好的分值。

獲得主動安全五星成績,僅僅是MAXIEYE的單視覺L2方案能力的一部分。更為重要的是,MAXIEYE的L2方案所具備的 數據回傳能力。

“ 單視覺方案最怕的是一些Ghost(鬼影)。”MAXIEYE創始人兼CEO周圣硯告訴HiEV,因為視覺無法形成深度信息,經過龍門架時,會把龍門架當成大卡車的車尾,進隧道時,也可能把隧道的桿子當成車尾,而要解決鬼影問題,就需要大量的數據積累。

為了做好數據積累,早在2019年左右,MAXIEYE發布1R1V方案時,就為這套方案設計了支持數據回傳和事件觸發視頻回傳的機制。這是當時行業的其他方案沒有考量的。

MAXIEYE在1R1V方案中運行了單V的影子系統,利用影子系統,可以把由于 缺少毫米波雷達校驗所產生的AEB誤觸發數據全部回傳回來,用于之后的數據訓練和算法迭代。

據介紹,在1R1V和單V方案市場,MAXIEYE是 唯一一家具備數據回傳能力的公司。

為了開發這樣一套系統,MAXIEYE在選擇芯片時,就要求芯片 必須支持H.264視頻編碼。“視頻編碼直接決定了方案的后續能力,比如影子系統、數據回傳,以及通過回傳來訓練深度學習的卷積網絡。”

彼時,一款芯片既要有足夠的算力去部署深度學習算法,同時又支持H.264編碼,這樣的芯片產品并不多,它考驗的是芯片公司的IP設計和產品定義能力。

據了解,許多智駕方案供應商早期推出的芯片并不具備H.264視頻編碼能力,數據回傳主要靠大量的人工成本,在方案量產之前通過大量的試驗車采集各種工況數據,數據獲取的成本相對較高。

除了芯片,MAXIEYE自身也基于底層感知自研算法,實現視覺感知網絡的迭代。目前已經實現高測距測速精度、高環境適應性。

受限于芯片算力,L2的算法采用的是 MAXI-NET 1.0深度學習網絡。

據周圣硯介紹,機器學習對算法檢測率的提升主要來自兩個途徑:

一是,提升卷積網絡設計,采用運算能力比較大的卷積網絡;

二是,在量產的產品上,由于可用的算力不高,通常為2 - 4TOPS,此時想要提高檢測率就要通過數據。

最終,MAXIEYE選擇了安霸和TI的芯片,并通過算法的不斷迭代,獲取大量量產上車的L2方案回傳的數據,其場景數據規模量已經累計超2億公里。

這種前瞻性設計,為后來解決AEB誤觸發、獲得CNCAP主動安全五星成績打下了基礎。

更關鍵的是,它還為系統向高階輔助駕駛迭代留出空間。

主機廠為了提高競爭力,需要提升L2的 搭載率,并且方案最好支持向L2+、L2++等高階功能進化。

要做到高階輔助駕駛,要包含上下匝道、過路口等,核心是解決路口的拓撲。

MAXIEYE的單V方案可以支持在經過十字路口時,按照設計好的觸發機制,將過路口前后五秒的視頻回傳到云端。同時,MAXIEYE在云端為主機廠準備了一套 VSLAM和地圖重構的算法,將單V的視頻用VSLAM的方式創建整個道路拓撲,作為高階的地圖真值去訓練高階輔助駕駛。

周圣硯認為,雖然單V的算力有限,運行不了BEV算法,無法感知道路的分叉、匯合等拓撲信息,但行業當下L2和L2+的配置率大概會是8 : 2。可以用80%車輛L2采集的數據,為20%車輛提供城市NOA道路拓撲信息。

這一過程考驗的便是 數據閉環能力。

它要求:

整車廠的車輛具備以太網的架構,以太網不止用于ADAS的數據回傳,還可以用于車機等;

智駕供應商具備數據脫敏能力,要用算法把行人的臉、車牌照信息脫敏,L2方案的芯片算力本身有限,將數據脫敏算法植入進去,技術挑戰頗大。

站在主機廠的角度,如果不具備數據回傳能力,意味著和燃油車時代的“放養”沒有任何區別。而且,由于L2的配置率很高,如果無法支持數據回傳,數十萬乃至近百萬輛車無監管地行駛在路上,主機廠對于車輛的數據掌控力也會變弱。

具備數據回傳能力后,主機廠可以聯合智駕供應商一起設計觸發機制,提供基于觸發機制的數據回傳,以還原現場。

它不僅可以提升ADAS本身的性能,也能拓展L2的功能邊界。

比如,安全氣囊起爆后,如果將起爆前后五秒進行數據回傳,就可以幫助主機廠用來做起爆點的設計等等。

目前看,要進入智能駕駛領域, 單視覺L2基本上是性價比最高的入場券了。

對于主機廠來說,一方面這張入場券的成本更低。另一方面,也是更為關鍵的,它能為進入NOA等高階自動駕駛做好準備。

單視覺L2采集的數據,可以做場景觸發,將數據回傳支持NOA的迭代。也就是說,遇到的每個corner case,都能攢下經驗值,為以后的算法迭代打下基礎。

對于售價更低比如售價10萬元以下的車型來說,成本更低且具備數據積累能力的智駕方案,是有著不錯的吸引力的。

最終,用戶感受到的是 更加安全的巡航功能,主機廠可以在主動安全方面獲得CNCAP五星評分,并且具備了數據迭代能力。

未來某天,隨著傳感器本身成本下降,單視覺L2的硬件可能會被替換,但那時,主機廠已經從算法層面獲取更多的海量數據,拿到了邁入高階輔助駕駛的入場券。

來源:第一電動網

作者:HiEV

本文地址:http://www.155ck.com/kol/203359

文中圖片源自互聯網,如有侵權請聯系admin#d1ev.com(#替換成@)刪除。