蓋世汽車訊 想象一下看一會兒繁忙的街道,然后嘗試勾畫出從記憶中看到的場景。大多數人都可以畫出汽車、人和人行橫道等主要物體的大致位置,但幾乎沒有人能夠以像素完美的精度畫出每個細節。大多數現代計算機視覺算法也是如此:它們非常擅長捕捉場景的高級細節,但在處理信息時會丟失細粒度的細節。

據外媒報道,麻省理工學院(MIT)的研究人員創建出名為“FeatUp”的系統,可以讓算法同時捕獲場景的所有高級和低級細節——幾乎就像計算機視覺的激光近視手術一樣。

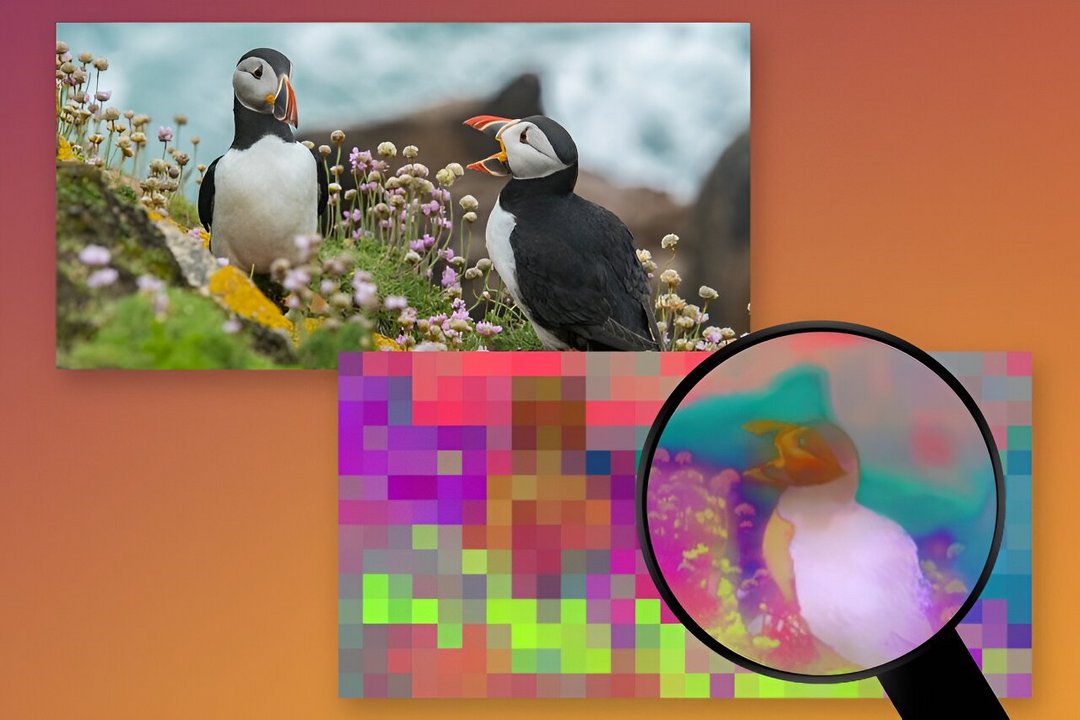

圖片來源:麻省理工學院

當通過查看圖像和視頻來學習“看”時,計算機會通過稱為“特征”的東西建立對場景中內容的“想法”。為了創建這些功能,深度網絡和視覺基礎模型將圖像分解為小方塊網格,并將這些方塊作為一個組進行處理,以確定照片中發生了什么。每個小方塊通常由16到32個像素組成,因此這些算法的分辨率比它們處理的圖像要小得多。在嘗試總結和理解照片時,算法會損失大量像素清晰度。

FeatUp算法可以阻止這種信息丟失并提高任何深度網絡的分辨率,而不會影響速度或質量。這使得研究人員能夠快速、輕松地提高新的或現有算法的分辨率。例如,想象一下嘗試解釋肺癌檢測算法的預測,以定位腫瘤。在使用類激活圖(CAM)等方法解釋算法之前應用FeatUp,可以根據模型產生腫瘤可能所在位置的更加詳細的(16-32x)視圖。

來源:第一電動網

作者:蓋世汽車

本文地址:http://www.155ck.com/news/shichang/223297

以上內容轉載自蓋世汽車,目的在于傳播更多信息,如有侵僅請聯系admin#d1ev.com(#替換成@)刪除,轉載內容并不代表第一電動網(www.155ck.com)立場。

文中圖片源自互聯網,如有侵權請聯系admin#d1ev.com(#替換成@)刪除。