蓋世汽車訊 大型語言模型(LLM)是基于人工智能的先進對話系統,可以回答用戶查詢并按照人類指令生成文本。OpenAI開發的高性能模型ChatGPT出現后,這些模型變得越來越受歡迎,并且越來越多的公司開始投資并開發。

盡管承諾實時回答人類問題并為特定目的創建文本,但LLM有時會生成無意義、不準確或不相關的文本,這些文本與人類用戶提供給他們的提示不同。這種現象通常與用于訓練模型的數據的局限性或其潛在推理中的錯誤有關,被稱為LLM“幻覺”。

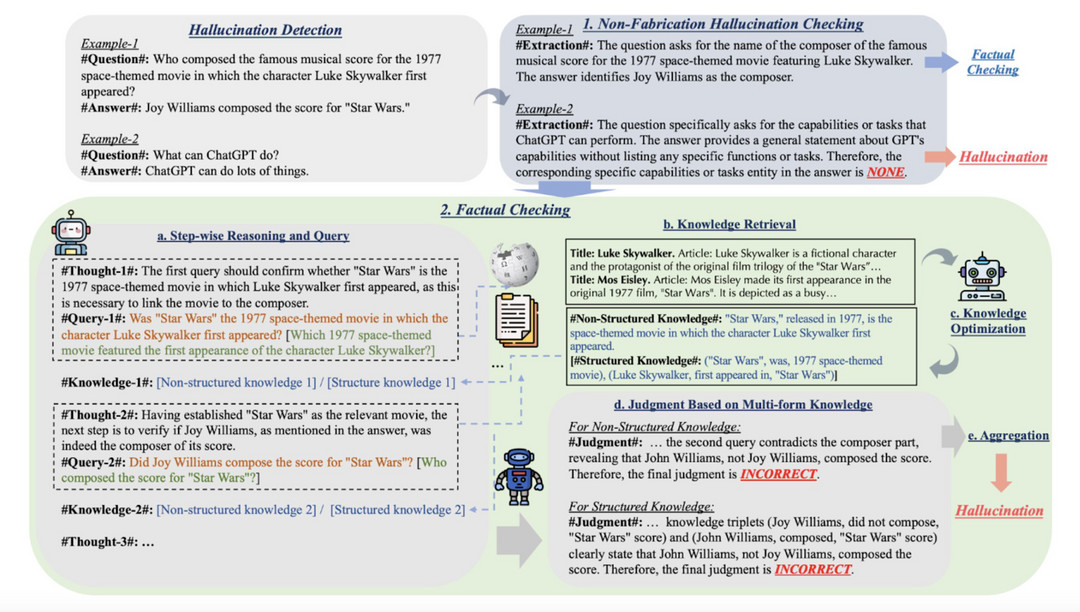

據外媒報道,伊利諾伊大學厄巴納-香檳分校(University of Illinois Urbana-Champaign)研究人員最近推出一個用于檢測LLM生成文本中的幻覺的框架KnowHalu。據悉,相關論文已上傳在arXiv網站,介紹稱可以幫助提高這些模型的可靠性,并簡化完成各種文本生成任務的使用。

圖片來源:arXiv網站

“隨著LLM的不斷進步,幻覺成為阻礙其在現實世界更廣泛應用的一個關鍵障礙,”該項目顧問Bo Li表示。“盡管大量研究已經解決了LLM的幻覺,但現有的方法往往無法有效利用現實世界的知識或利用效率低下。受這一差距的啟發,我們為LLM開發了一種新穎的多形式基于知識的幻覺檢測框架。此外,我們還發現,當前有關非制造幻覺的研究存在差距:事實正確但與查詢無關或不特定的響應”。”

來源:第一電動網

作者:蓋世汽車

本文地址:http://www.155ck.com/news/shichang/230238

以上內容轉載自蓋世汽車,目的在于傳播更多信息,如有侵僅請聯系admin#d1ev.com(#替換成@)刪除,轉載內容并不代表第一電動網(www.155ck.com)立場。

文中圖片源自互聯網,如有侵權請聯系admin#d1ev.com(#替換成@)刪除。